- Home /

- Publicaciones de patentes /

- Sistema de evacuación de patrones emocionales faciales basado en interacción de metodologías de investigación , extracción de datos, modelos teóricos propios e inteligencia artificial

Patente nacional por "Sistema de evacuación de patrones emocionales faciales basado en interacción de metodologías de investigación , extracción de datos, modelos teóricos propios e inteligencia artificial"

Este registro ha sido solicitado por

DESARROLLO DE INTELIGENCIA ARTIFICIAL Y PSICOLOGIA S.L.

a través del representanteMARÍA JOSEFA VILLA JIMÉNEZ

Contacto

- Estado: Vigente

- País:

- España

- Fecha solicitud:

- 25/07/2022

- Número solicitud:

-

P202200065

- Número publicación:

-

ES2959222

- Fecha de concesión:

-

- Inventores:

-

Persona física

- Datos del titular:

-

DESARROLLO DE INTELIGENCIA ARTIFICIAL Y PSICOLOGIA S.L.

- Datos del representante:

-

María Josefa VILLA JIMÉNEZ

- Clasificación Internacional de Patentes:

- G06N 5/045

- Clasificación Internacional de Patentes de la publicación:

- G06N 5/045

- Fecha de vencimiento:

Quiero registrar una patente

Reivindicaciones:

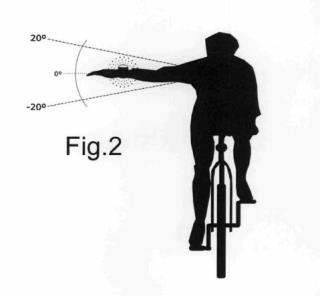

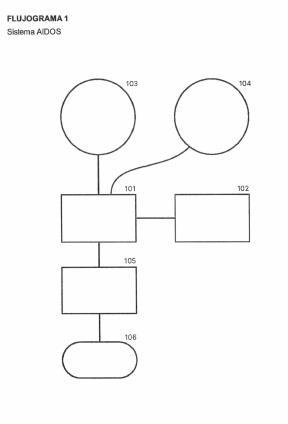

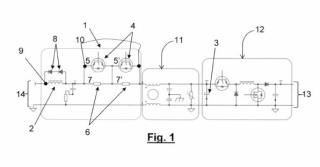

+ ES-2959222_A11. Sistema de evaluación a partir de patrones emocionales faciales y mediciones de la variación de datos fisiológicos basado en la interacción de metodologías de investigación propias de la inteligencia artificial y la Psicología, para la extracción de datos y procesamiento, uso de algoritmos y modelos de inteligencia artificial que realiza el análisis de las emociones del rostro de un sujeto evaluado ante su exposición a imágenes analizándolos con patrones emocionales de distintos perfiles almacenados en una base de datos propia validada científicamente del Sistema caracterizada por la emisión automática de un informe de asesoramiento que otorga información del sujeto evaluado con un determinado grado de confianza estadística sobre (i) el sistema de valores de referencia individuales de comprensión e interpretación de la realidad social del Sujeto; (i) Extremismo y Radicalismo en los Valores de referencia del Sujeto; (ii) nivel de falta de empatía del sujeto ante el dolor y sufrimiento ajeno (sadismo y alexitimia) , y que comprende: - Un dispositivo de captación de video e imágenes en alta resolución 4K. - Un dispositivo de captación de temperatura corporal. - Un dispositivo de captación del nivel de estrés fisiológico del sujeto (solo para evaluación individualizada, no en tránsito) . - Un dispositivo de emisión de video configurado para exponer/presentar un flujo de imágenes. - Un dispositivo periférico sujeto (sólo para evaluación individualizada, no en tránsito) para la recogida de datos. - Un grupo de unidades de procesamiento que incluye: • Emisor de flujo de video e imágenes de alto ancho de banda a los I servidores del Sistema que cuenta con un sistema de encriptación y anonimización. • Emisor de transformación de imágenes en datos numéricos expresivos de las emociones del sujeto mediante procesamiento basado en la IA ante cada imagen percibida por cada persona evaluada que cuenta con un sistema de encriptación y anonimización. • Emisor de flujo de video e imágenes de percepción de temperatura a los servidores del Sistema que cuenta con un sistema de encriptación y anonimización. • Emisor de flujo de niveles de estrés fisiológico de la persona evaluada a los servidores del Sistema que cuenta con un sistema de encriptación y anonimización. • Emisor de transformación de todos los datos recibidos en el Sisterna por parte de la IA y los algoritmos del Sistema en patrones y perfiles que cuenta con un sistema de encriptación y anonimización. • Dispositivo de análisis de patrones y perfiles individuales del sujeto evaluado mediante algoritmos de decisión del Sisterna con patrón/es almacenados en la base de datos del Sistema. • Dispositivo de emisor de respuesta a través de los algoritmos de informe/s de resultados que cuenta con un sistema de encriptación y anonimización. - Distintos algoritmos de inteligencia artificial (IA) . - Bases de datos propias de perfiles prototípicos, según modelos teóricos y prácticos, con patrones de respuestas emocionales de personas, validadas científicamente. 2. Sistema según Reivindicación 1 en donde los dispositivos de captación adquieren, reciben y procesan el flujo de información capturado sobre la medición y aparición de modificaciones de emperatura corporal, nivel de estrés, y emociones faciales ante la exposición de las imágenes a través del dispositivo de emisión de video al sujeto evaluado. 4. Sistema según Reivindicación 1 y 2 en el que el análisis de emociones tiene en cuenta la expresión facial y la mirada, los gestos y los microgestos indicadores de sonrisa, decepción, miedo, interés, tristeza, neutralidad, felicidad, ira, y la detección y procesamiento de otras variables como los grados de inclinación de las cejas, de las comisuras, la variación en la distancia (acercamiento o alejamiento) al objeto de evaluación, tiempo de reacción, evitación del objeto de evaluación, etc. 5. Sistema según Reivindicación 1 en el que en el que el análisis de emociones del sujeto evaluado, mediante Inteligencia Artificial, tiene en cuenta, para determinar la emoción experimentada por el sujeto, la variación o variaciones que experimenta la persona ante la exposición de las imágenes validadas científicamente del Sistema a través de los dispositivos de emisión de video caracterizado por: - La aplicación de algoritmos y modelos basados en Inteligencia Artificial (IA) tiene en cuenta la variación del conjunto de estructuras musculares que reciben su inervación motora del nervio facial: el músculo frontal, el músculo prócera o piramidal de la nariz, el músculo corrugado de la ceja o superciliar, el músculo 5 elevador del labio superior y del ala nasal, el músculo elevador del ángulo de la boca, el músculo cigomático mayor, el músculo cigomático menor, el músculo risorio, el músculo depresor del tabique nasal o mirtiforme, el músculo depresor del ángulo de la boca o triangular, el músculo mental o mentoniano y el músculo depresor del labio inferior. - El procesamiento mediante modelos de Inteligencia Artificial (IA) , entrenados empleando algoritmos de IA para el procesamiento de flujos de imágenes, del flujo de entrada de video para la extracción de los recuadros que contienen la imágenes faciales y térmicas provenientes de cada una de las personas capturadas y su identificación única para poder realizar un seguimiento individualizado de cada uno de los sujetos durante todo el tiempo que es capturado por el sistema de captación de imágenes. - El procesamiento mediante algoritmos de Inteligencia Artificial (IA) de las Imágenes captadas de la persona reaccionando a las imágenes presentadas al sujeto en evaluación a través del dispositivo de emisión de imagen/video para transformarlas en códigos numéricos interpretables para los algoritmos del Sistema. - El procesamiento de los códigos numéricos generados/calculados por los modelos y los algoritmos de IA en patrón o patrones y perfil o perfiles que puedan ser tratados para su análisis por parte de los algoritmos del Sistema. - El procesamiento del patrón o patrones, perfil o perfiles, de cada sujeto evaluado mediante análisis con los modelos almacenados en la bases de datos propia para que los algoritmos del Sistema establezcan los niveles de coincidencia entre el sujeto evaluado y los patrones o perfiles a detectar según un nivel de confianza estadística, con el objeto de clasificar, establecer y marcar como de interés aquellos sujetos que puedan ser requeridos por parte del usuario del Sistema como relevantes y así determinar su grado de coincidencia con un determinado nivel de confianza estadística con los distintos nivel de perfiles del Sistema. - Analizar el patrón o patrones de datos captados y procesados con los perfiles prototípicos predeterminados del Sistema basados en tecnología de aprendizaje automático o marching learning. El número de patrones prototípicos a ser usados en el Sistema puede variar en función de la necesidad del usuario. Así mismo, las características que definen dichos patrones pueden ariar con el tiempo (i.e., se pueden recalcular) , a medida que se retroalimente el Sistema con nuevos datos. - Los algoritmos de IA y los modelos aplicados por el Sistema podrán ser modificados por aprendizaje automático en la acumulación de datos y la modificación mediante actualizaciones del Sistema para mejorar los procesos de IA en el que se basan la toma de decisiones empleando estrategias/algoritmos de re-entrenamiento. - La creación de modelos de reconocimiento de patrones emocionales basados en modelos tanto teóricos -basados en la Psicología y la IA - como en modelos prácticos -basados en el análisis de datos y modelos matemáticos obtenidos mediante entrevistas y pruebas estandarizadas, procesados con metodologías propias del análisis masivo de datos y la psicometría. - La realización de un perfil individual del sujeto de acuerdo con un nivel de confianza estadística determinado. La confluencia de información y decisiones tomadas por los algoritmos del Sistema (y los modelos que lo representan) será procesada según las necesidades previamente marcadas por el usuario del Sistema, que determinará si el sujeto reúne las características o no y en qué grado. 5. Sistema según Reivindicación 4 en el que el perfil individual se muestra como una herramienta de ayuda con carácter de asesoramiento en la toma de decisiones ante la constatación de la presencia o no de un sujeto perteneciente a un grupo de interés para el usuario del Sistema y, en caso afirmativo, de acuerdo con un grado de confianza estadística su (i) Sistema de valores y creencias de referencia existencial del individuo; (ii) Presencia de valores y creencias compatibles o incompatibles con valores democráticos y de igualdad, entre otros; (iii) Falta de empatía ante el dolor y sufrimiento ajeno (sadismo y alexitimia) y si éste aparece de forma, especial ante determinados grupos sociales, religiosos o étnicos, en donde esta información se muestra en pantalla de forma gráfica, numérica y por escrito, mostrando los niveles de confianza estadística con cada grupo de referencia, el nivel aproximado de certeza del asesoramiento ofrecido por coincidencia con los patrones preestablecidos en el Sistema. 6. Sistema según Reivindicación 4 en donde el patrón o patrones de respuesta emocional del sujeto evaluado toma como un indicador objetivo no controlado de valores actitudinales, emocionales y cognitivos, no necesariamente conductuales o de intención, caracterizado por: - Los datos recibidos por los dispositivos externos y la toma de decisiones derivadas de todas las unidades de procesamiento del Sistema. - Las expresiones faciales detectadas, transformadas en códigos numéricos y posteriormente en patrones y perfiles. Esta información es empleada para el análisis de los algoritmos y modelos que generarán el perfil de la persona evaluada y el informe de asesoramiento con un grado de confianza estadística. - Seis modelos matemáticos de referencia predefinidos que modelan los datos provenientes de la detección y procesamiento de los estados emocionales del sujeto. 7. Sistema según Reivindicación 1 en el que las unidades de procesamiento están configuradas para procesar la información que reciben de los dispositivos de captura y establecer mediante modelos y algoritmos, niveles de análisis que conducen a la otorgación de pesos matemáticos probabilísticos acumulativos ante el visionado de cada imagen y su correspondiente reacción emocional, facilitando la toma de decisiones por parte de los algoritmos del Sistema. 8. Sistema según Reivindicación 1 en el que mediante el procesamiento de los datos recogidos por el Sistema se elabora automáticamente un informe del sujeto evaluado que indica el nivel de confianza estadística con los patrones previamente seleccionados por el usuario del Sistema como relevantes para ser objeto de estudio en la persona evaluada y el grado de fiabilidad en el que se basa el asesoramiento que realiza. 9. Sistema según Reivindicación 4 en el que los patrones de referencia del Sistema están basados en modelos matemáticos, resultado de datos objetivos, científicas y validados según metodología propias de la psicometría y el análisis masivo de datos, y que comprenden modelos de estados emocionales que se ajustan a respuestas prototípicas según los análisis matemáticos validados, que son referencia y coincidentes según distintos valores y creencias de referencia basados en los sistemas de creencias culturales monoteístas abrahámicas, su nivel de radicalismo y extremismo, con justificación de la violencia propia o de otros como recurso para la imposición del sistema de valores del sujeto y del grado de empatía o su ausencia ante el dolor ajeno animal o humano (sadismo y alexitimia) , especialmente si éste se da en grupos de pertenencia ajenos a aquel con el que el sujeto evaluado se identifica. 10. Sistema basado según las reivindicaciones 1 y 2 anteriores en el que el grupo de dispositivos incluye los siguientes elementos: - Un dispositivo de captación de vídeo e imágenes en alta resolución 4K. - Un dispositivo de captación de temperatura corporal. - Un dispositivo de captación del nivel de estrés fisiológico del sujeto (sólo para evaluación individualizada, no en tránsito) para la recogida de datos. - Un dispositivo periférico sujeto ( sólo para la evaluación individualizada, no en tránsito) para la recogida de datos. - Un dispositivo de emisión de video configurado para exponer/presentar un flujo de imágenes. 11. Sistema basado en la Reivindicación 10 en el que los dispositivos están configurados para recibir, recoger y proporcionar al Sistema datos indicativos de parámetros fisiológicos de una persona que muestren: - La variación del conjunto de estructuras musculares que reciben su inervación motora del nervio facial para detectar cualquier indicio de emoción o el intento de ocultación de la misma. En este proceso se involucra la medición o alteración por mínima que sea de los siguientes músculos: el músculo frontal, el músculo prócero o piramidal de la nariz, el músculo corrugador de la ceja o superciliar, el músculo elevador del labio superior y del ala nasal, el músculo elevador del ángulo de la boca, el músculo cigomático mayor, el músculo cigomático menor, el músculo risorio, el músculo depresor del tabique nasal o mirtiforme, el músculo depresor del ángulo de la boca o triangular, el músculo mental o mentoniano y el músculo depresor del labio inferior. - La variación de temperatura corporal, especialmente la facial. - La variación de niveles de estrés fisiológico. 12. Sistema según Reivindicación 10 anterior en el que el dispositivo propio de emisión de imágenes puede emitir imágenes en pantalla adaptada para el visionado del sujeto o sujetos en evaluación, en movimiento, sentado, quieto, de pie, en tránsito o espera. 13. Sistema basado según las reivindicaciones anteriores números del 1 al 4 que comprende los siguientes algoritmos de inteligencia artificial (IA) : - Algoritmo de detección de las creencias y valores de la persona evaluada según el sistema de creencias y valores propios de cualquiera de los sistemas culturales basados en las visiones monoteístas abrahámicas. - Algoritmo de determinación del nivel o grado de las creencias y valores de la persona evaluada según el sistema de creencias y valores propios de cualquiera de los sistemas culturales basados en las visiones monoteístas abrahámicas. - Algoritmo de detección de la presencia de radicalismo y extremismo en las creencias y valores de la persona evaluada según el sistema de creencias y valores propios de cualquiera de los sistemas culturales basados en las visiones monoteístas abrahámicas, de acuerdo a un grado de confianza estadística determinada y expresada en los resultados finales. - Algoritmo de detección de la presencia de la falta de empatía o de presencia de falta de emociones de la persona evaluada (sadismo y alexitimia) . - Algoritmo de detección del nivel de la presencia de la falta de empatía o de presencia de falta de emociones de la persona evaluada (sadismo y alexitimia) . 14. Sistema basado según reivindicación 1 que comprende la creación y transformación de datos recogidos en perfiles prototípicos según los modelos teóricos y prácticos como base de datos propias del Sistema validadas científicamente. 15. Sistema basado según las reivindicaciones anteriores en el que se emite automáticamente un informe del sujeto evaluado basado en los datos obtenidos por los sistemas externos, los modelos, los algoritmos y las unidades de procesamiento caracterizado por la: - Realización de un informe individual en tipología gráfico y escrito, con los resultados de la persona evaluada conforme a las especificaciones previas solicitadas por el usuario del Sistema. - Realización de informe individual explicativo con información numérica, gráfica, detallada, cuantitativa y cualitativa de las respuestas y patrones obtenidos. Informe basado en varios modelos de informe gráfico, numérico y escrito con los resultados de la persona evaluada conforme a las especificaciones previas solicitadas por el usuario del Sistema y en el que el informe detallado será accesible únicamente para un perfil de usuario del Sistema autorizado previamente.

Los productos y servicios protegidos por este registro son:

G06N 5/045

Descripciones: