- Home /

- Publicaciones de patentes /

- Sistema y método de detección en tiempo real de estados emocionales mediante visión artificial y escucha del lenguaje natural

Patente nacional por "Sistema y método de detección en tiempo real de estados emocionales mediante visión artificial y escucha del lenguaje natural"

Este registro ha sido solicitado por

NEUROLOGYCA SCIENCE & MARKETING SL

a través del representanteSILVIA HERNÁNDEZ PRESAS

Contacto

- Estado: Vigente

- País:

- España

- Fecha solicitud:

- 03/06/2022

- Número solicitud:

-

P202230488

- Número publicación:

-

ES2957419

- Fecha de concesión:

-

- Inventores:

-

Persona física

- Datos del titular:

-

NEUROLOGYCA SCIENCE & MARKETING SL

- Datos del representante:

-

Silvia Hernández Presas

- Clasificación Internacional de Patentes:

- G06V 40/16,G10L 25/63

- Clasificación Internacional de Patentes de la publicación:

- G06V 40/16,G10L 25/63

- Fecha de vencimiento:

Quiero registrar una patente

Reivindicaciones:

+ ES-2957419_A11. Un método implementado por computador de detección en tiempo real de estados emocionales mediante visión artificial y escucha del lenguaje natural que comprende: una primera etapa de captura de datos, donde dichos datos comprenden al menos una imagen de un individuo y al menos un fragmento de audio de un habla de dicho individuo; una segunda etapa de filtrado de los datos capturados en la primera etapa y que comprende, a su vez: un primer filtrado configurado para eliminar imágenes sin rostro o con elementos que tapen o hagan indistinguibles los rasgos faciales; y un segundo filtrado configurado para eliminar imágenes descuadradas o con una postura inadecuada para su medición; una tercera etapa de procesado de las imágenes válidas obtenidas en la segunda etapa de filtrado; una cuarta etapa de generación de datos configurada para obtener al menos un conjunto de datos interpretados tanto por individuo como el conjunto agregado de todos los individuos y bloque de investigación; y una quinta etapa de salida de datos. 2. El método de acuerdo con la reivindicación 1 donde la etapa de captura de datos puede realizarse en local o en remoto mediante un enlace de conexión web. 3. El método de acuerdo con la reivindicación 1 donde los datos capturados en la primera etapa pueden ser descargados y almacenados en una memoria de forma previa a su procesamiento, o bien pueden ser procesados directamente en tiempo real, sin descarga o almacenamiento previo. 4. El método de acuerdo con la reivindicación 1 donde las imágenes válidas y las imágenes descartadas en la segunda etapa de filtrado se almacenan en ubicaciones diferenciadas dentro de la memoria. 5. Un sistema de detección en tiempo real de estados emocionales mediante visión artificial y escucha del lenguaje natural que comprende: un procesador; una tarjeta gráfica; una entrada de captura de imágenes; una salida de datos; un micrófono ambiental; al menos una memoria; y un programa o programas que están almacenados en la memoria y configurados para ejecutarse por el procesador, caracterizado porque los programas incluyen Instrucciones que, cuando son ejecutadas por el procesador (41) hacen que el sistema ejecute el método de acuerdo con una cualquiera de las reivindicaciones 1 a 4. 6. Un producto de programa informático con instrucciones configuradas para su ejecución por uno o más procesadores que, cuando son ejecutadas por el sistema de la reivindicación 5 hacen que lleve a cabo el método según cualquiera de las reivindicaciones 1 a 4.

Los productos y servicios protegidos por este registro son:

G06V 40/16 - G10L 25/63

Descripciones:

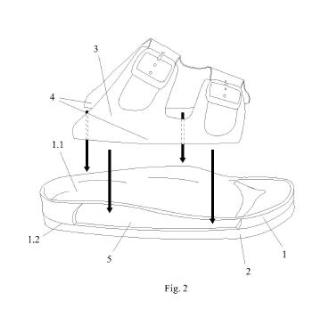

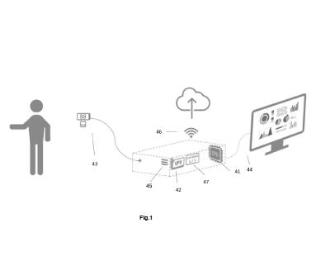

+ ES-2957419_A1 Sistema y método de detección en tiempo real de estados emocionales mediante visión artificial y escucha del lenguaje natural Campo técnico La presente invención está referida a un sistema y un método de detección en tiempo real de estados emocionales mediante visión artificial y escucha del lenguaje natural, que tiene como propósito investigar y desarrollar soluciones basadas en la neurociencia para entender al ser humano y proporcionar un conocimiento profundo de sus emociones, comportamiento, actitudes, estado de ánimo y toma de decisiones. Estado de la técnica anterior En la actualidad, son conocidas diversos métodos de investigación del comportamiento y preferencias de los consumidores mediante metodologías y tecnologías venidas de la neurociencia, entre los que destacan el desarrollo de numerosos estudios de neuromarketing utilizando aparatos de medición biométrica y de actividad mental. Estos estudios suelen resultar lentos y caros debido a que la investigación de los sujetos debe realizarse persona a persona y a que se debe conectar manualmente a cada una de estas personas estudiadas a las diferentes tecnologías, así como realizarlas sin ningún tipo de anonimato lo que podría provocar un sesgo intrusivo en las mismas. Por un lado, encontramos la patente americana US 9 141 604 B2, una tecnología de evaluación de las emociones humanas - sistema y método - que describe un método novedoso de análisis y presentación de resultados de la emoción humana durante una sesión como chat, vídeo, audio y combinación de los mismos en tiempo real. El análisis se realiza mediante el análisis semiótico y la agrupación jerárquica de pendientes para dar retroalimentación para una sesión o sesiones históricas al usuario o a cualquier profesional. El método y el sistema son útiles para reconocer la reacción para una sesión particular o la detección de un comportamiento anormal. El método y sistema con algoritmo único es útil para obtener una retroalimentación instantánea para mantener el rumbo o cambiar de estrategia para un resultado deseado durante la sesión. Así mismo, la patente americana US 2010/0325078 A1, un dispositivo y método para reconocer la emoción y la intención de un usuario donde se proporciona un dispositivo y un método de reconocimiento de la intención del usuario. El dispositivo de reconocimiento de la intención del usuario puede ser utilizado por una persona que no es capaz de expresar adecuadamente su emoción e intención, como una persona discapacitada, un paciente, y similares. El dispositivo de reconocimiento de la intención del usuario puede determinar una emoción del usuario basada en la información de comunicación del usuario, y también, puede determinar una intención del usuario basada en la emoción y la información biométrica del usuario. El dispositivo de reconocimiento de la intención del usuario puede proporcionar una salida apropiada correspondiente a la intención determinada del usuario. La patente americana US 7827 126 B2, un método para cambiar la emoción del robot de software donde se divulga un método para cambiar la emoción de un robot de software ("sobot") en un terminal de "sobot". El terminal de "sobot" incluye una unidad de memoria a corto plazo y una unidad de memoria a largo plazo. Cuando se produce un cambio emocional durante el funcionamiento de la unidad de memoria a corto plazo, el terminal de "sobot" almacena un valor de emoción de referencia a corto plazo de la emoción correspondiente en la memoria de referencia a largo plazo. Cuando transcurre el tiempo de funcionamiento de la unidad de memoria a largo plazo, el terminal de "sobot" restablece el valor de emoción de referencia a largo plazo utilizando los valores de emoción de referencia a corto plazo almacenados en la unidad de memoria a largo plazo. El terminal de "sobot" puede cambiar la emoción del "sobot" de forma más natural a través del proceso anterior. La patente americana US 8214214 B2, un dispositivo y método de detección de emociones para su uso en sistemas distribuidos que consiste en un analizador de prosodia que mejora la interpretación de los enunciados del lenguaje natural. El analizador está distribuido en una arquitectura cliente/servidor, de modo que el alcance de las tareas de procesamiento de reconocimiento de emociones puede asignarse de forma dinámica en función de los recursos de procesamiento, las condiciones del canal, la carga del cliente, etc. Los datos prosódicos parcialmente procesados pueden enviarse por separado o combinarse con otros datos del habla del dispositivo cliente y transmitirse a un servidor para obtener una respuesta en tiempo real. El entrenamiento del analizador de prosodia con las respuestas esperadas en el mundo real mejora el modelado de las emociones y la identificación en tiempo real de posibles características como el énfasis, la intención, la actitud y el significado semántico en los enunciados del hablante. La solicitud internacional WO 02/41191 A1, un método y aparato para analizar el afecto y la emoción en el texto donde se presenta un método asistido por ordenador para clasificar un documento de texto según la emoción y el afecto. Se asigna una puntuación a cada término de afecto en el documento. Se calcula una puntuación de afecto para el documento a partir de las puntuaciones de cada término de afecto. El documento se clasifica entonces de acuerdo con la puntuación de afecto. También se divulga un aparato para realizar el método asistido por ordenador. La solicitud internacional WO 02/067194 A2, un sistema de modelización y simulación de estados emocionales, que incluye (a) la tabla de emociones Placer-Arousal-Dominancia (PAD) que hace posible (b) convertir los términos de emoción a sus respectivos valores PAD, (c) una fórmula para trabajar hacia atrás desde cualquier conjunto específico de valores PAD para derivar un único término de emoción que se ajuste mejor a esa combinación particular de valores PAD, (d) una fórmula para calcular la distancia entre un conjunto preseleccionado de valores PAD y el término de emoción más cercano que se ajusta a esos valores PAD, (e) un método para calcular la respuesta emocional media de un grupo a cualquier situación o estímulo, permitiendo así la derivación de un único término de emoción que represente mejor la experiencia emocional media del grupo, (f) un procedimiento genérico para derivar términos de emoción de modelos estadísticos multidimensionales. La presente invención se utiliza como simulador de emociones, especialmente en el campo de los sistemas de bucle cerrado y abierto, como un sistema de calefacción, para representar el funcionamiento del sistema. La invención americana US 7 451 079, un método y dispositivo de reconocimiento de emociones donde el reconocimiento de emociones se realiza extrayendo un conjunto que comprende al menos una característica derivada de una señal, y procesando el conjunto de características extraídas para detectar una emoción a partir de ellas. La señal de voz se filtra a paso bajo antes de extraer de ella al menos una característica del conjunto. La frecuencia de corte para el filtrado de paso bajo se centra típicamente alrededor de 250 Hz. Las características son, por ejemplo, cantidades estadísticas extraídas del muestreo de una señal de la intensidad o el tono de la señal de voz. La solicitud internacional WO 2016/014321 A1, un reconocimiento de emociones en tiempo real a partir de señales de audio donde se proporcionan sistemas, métodos y medios de almacenamiento legibles por ordenador para reconocer emociones en señales de audio en tiempo real. Se detecta una señal de audio y se calcula una huella digital de audio rápida en el dispositivo informático de un usuario. Una o más características se extraen de la huella igital de audio y se comparan con las características asociadas con las emociones definidas para determinar los grados relativos de similitud. Las puntuaciones de confianza se calculan para las emociones definidas basándose en los grados relativos de similitud y se determina si una puntuación de confianza para una o más emociones particulares supera una puntuación de confianza umbral. Si se determina que la puntuación de confianza del umbral para una o más emociones particulares se excede, la emoción o emociones particulares se asocian con la señal de audio. Si se desea, se pueden iniciar varias acciones basadas en la emoción o emociones asociadas a la señal de audio. Por último, la patente americana US 8364395 B2, una medición de las emociones humanas en los planes y mapas de navegación que consiste en un sistema de navegación mejorado que permite planificar la ruta de navegación y el destino según los criterios especificados por el usuario para el estado emocional de las personas a lo largo de la ruta, en el destino, o en ambos. La mejora se lleva a cabo recibiendo un conjunto de métricas de emoción humana correspondientes a una o más partes de un plan de navegación; determinando si las métricas de emoción humana cumplen uno o más criterios especificados por el usuario; respondiendo a que no se cumplan los criterios, determinando un plan de navegación alternativo hasta que se cumplan los criterios especificados por el usuario; y en respuesta al cumplimiento de los criterios, presentar el plan de navegación al usuario para su colocación en un sistema de navegación y, opcionalmente, durante la ejecución del plan de navegación, actualizar las métricas de emoción humana recibidas; repetir la determinación en función de los criterios especificados por el usuario; y repetir los pasos de determinación de un plan de navegación alternativo y la presentación a un usuario en respuesta a las métricas de emoción humana actualizadas que no cumplen los criterios especificados por el usuario. Por tanto, podemos observar como todas las invenciones arriba citadas aportan soluciones parciales de baja precisión y por separado. El objetivo de la invención aquí presentada mediante sus reivindicaciones es un sistema de hardware y su método, que detectan mediante webcam, escucha mediante micrófono integrado y procesa con un software que unifica todos los sistemas de medición por imagen de expresiones, gestos y lenguaje natural con un grado de eficacia y precisión superior, permitiendo así evaluar masivamente y de modo escalado los estados emocionales de los individuos sin mermar la posible calidad de los resultados, sin realizarse de un modo intrusivo y con una tecnología asequible, sencilla y manejable fácilmente por cualquiera que además pudiese aportar resultados sin necesidad de tener conocimientos en la materia. Explicación de la invención Es un objeto de la presente invención un método implementado por computador configurado para la detección en tiempo real de estados emocionales mediante visión artificial y escucha del lenguaje natural que comprende: (a) una primera etapa de captura de datos, donde dichos datos comprenden al menos una imagen de un individuo y al menos un fragmento de audio de un habla de dicho individuo; (b) una segunda etapa de filtrado de los datos capturados en la primera etapa y que comprende, a su vez: (b.1) un primer filtrado configurado para eliminar imágenes sin rostro o con elementos que tapen o hagan indistinguibles los rasgos faciales; y (b.2) un segundo filtrado configurado para eliminar imágenes descuadradas o con una postura inadecuada para su medición; (c) una tercera etapa de procesado de las imágenes válidas obtenidas en la segunda etapa de filtrado; (d) una cuarta etapa de generación de datos configurada para obtener al menos un conjunto de datos interpretados tanto por individuo como el conjunto agregado de todos los individuos y bloque de investigación; y (e) una quinta etapa de salida de datos. Gracias a su diseño, podemos obtener un sistema que engloba diferentes capas de inteligencia artificial convolucionadas que identifique, procese, interprete y comprenda rasgos complejos de la comunicación humana a través de la imagen y el sonido para la extracción de señales fisiológicas y cerebrales que identifiquen el estado de ánimo, estrés, lenguaje no verbal, veracidad del discurso y ofrecer una respuesta empática en consonancia a las personas a través de la visión artificial. Así, dicho sistema conseguirá descifrar las emociones creando algoritmos de reconocimiento del habla, de la voz, del lenguaje no verbal, de las emociones, del estado de ánimo. Dicho sistema está basado en la inteligencia artificial no intrusiva, lo que permite moldear aplicaciones de mercado y dotarlas con inmensas posibilidades. Una de las ventajas de dicho sistema es la posibilidad de potenciar la capacidad de conciencia del ser humano para lograr sus necesidades y deseos más importantes a través de una Red Neuronal que supera la inteligencia probada y aporta el conocimiento que proviene de una innovación tecnológica para superar la comprensión del ser humano en sus emociones, comportamiento, actitudes, estado de ánimo y toma de decisiones. Para ello, el sistema dispone de varios tipos de detectores que sirven de base del modelo de cálculo como puntos de control de los músculos faciales, gestos, ángulo, apertura/cierre de ojos y boca, cejas, el discurso hablado, etc. Este modelo de cálculo permitirá desarrollar oluciones para que las máquinas y cualquier otra tecnología puedan detectar emociones en los seres humanos, darles una nueva capa de entendimiento que permita realizar tareas y soluciones más complejas y cercanas a los intereses del ser humano y por otro lado servirá para tener un conocimiento más profundo del estado mental, riesgos, preferencias y toma de decisiones de las personas. Así mismo, partiendo de que el objetivo primario es detectar y entender las emociones, estados de ánimo y comportamiento de las personas, el sistema el sistema es capaz de detecta y medir, también, emociones, comportamientos, estados mentales, ansiedad, estrés, amenazas, discursos engañosos, así como otros indicadores claves y la predicción y recreación de dichos estados. Estos puntos son claves a la hora de entender tomas de decisiones, estados emocionales potencialmente peligrosos, intereses y aprendizajes de contenidos educativos y de publicidad, estados de estrés en diferentes situaciones que puedan entrañar un peligro de seguridad o bien un bajo rendimiento, así como un primer indicador para una enfermedad mental y/o física. Por lo tanto, dicho conocimiento permite desarrollar diferentes aplicaciones sobre una misma base de desarrollo que es el objeto de esta patente: investigación de mercado, comunicación, espectáculos, entretenimiento, seguridad, ciudades inteligentes, robots, domótica, juegos de azar-apuestas, seguridad en la conducción, IOT (internet de las cosas) , educación, recursos humanos, seguridad laboral, video llamadas, eventos masivos, procesos industriales, controles de calidad, política, ciberseguridad, entre otros. Breve descripción de los dibujos A continuación, se pasa a describir de manera muy breve una serie de dibujos que ayudan a comprender mejor la invención y que se relacionan expresamente con una realización de dicha invención, que se ilustra como un ejemplo no limitativo de ésta. La FIG.1 muestra un diagrama del sistema de detección en tiempo real de estados emocionales mediante visión artificial y escucha del lenguaje natural, objeto de la presente invención. La FIG.2 muestra un diagrama de bloques del método de detección en tiempo real de estados emocionales mediante visión artificial y escucha del lenguaje natural, objeto de la presente invención. La FIG.3 muestra un ejemplo de una imagen de un rostro de un individuo, donde se observa un excesivo contraste de iluminación entre el lado derecho e izquierdo, lo que invalidaría su uso como imagen válida tras el primer filtrado. La FIG.4 muestra un ejemplo de una imagen de un rostro de un individuo, donde se observa una imagen fuera del rango de medición, lo que invalidaría su uso como imagen válida tras el segundo filtrado. La FIG.5 muestra una primera gráfica comparativa entre la invención y los sistemas FACET y AFFECTIVA del estado de la técnica. La FIG.6 muestra una segunda gráfica comparativa entre la invención y los sistemas FACET y AFFECTIVA del estado de la técnica. La FIG.7 muestra un diagrama de los datos usados para el entrenamiento de la IA de la invención. Explicación de un modo detallado de realización de la invención Tal y como se ha indicado previamente, es un objeto de la presente invención un sistema y un método configurado para la detección e interpretación de las emociones de un ser humano. Para ello, se implementa un sistema y un modelo computacional que permite diferenciar emociones como son: ira, asco, miedo, alegría, tristeza, sorpresa, neutral, anticipación, confianza, amor, sumisión, asombro, desaprobación, remordimiento, desprecio, agresividad, optimismo, culpabilidad, curiosidad, desesperación, incredulidad, envidia, cinismo, orgullo, esperanza, deleite, sentimentalismo, vergüenza, indignación, pesimismo, morbo, dominio, ansiedad, predominante, tendencia, veracidad, valencia positiva, valencia negativa, intensidad, enfoque, interés, rechazo, compromiso, confusión, comprensión, confianza, atención y estrés. En definitiva, la presente invención está basada en metodologías propias de la neurociencia. Dichas metodologías han sido aplicadas obteniendo información biométrica y de actividad cerebral de miles de sujetos que sirve como base para crear nuevos modelos de cálculo basados en IA (Inteligencia Artificial) como ML y DL (Machine Learning y Deep Learning respectivamente) . En la presente invención se han tenido en cuentas bases de datos de más e 40.000 individuos con los siguientes datos de entrenamiento de la IA, que incluyen, de forma no limitativa: - Alegría, tristeza, enfado, sorpresa, asco, rechazo y neutralidad. - Nivel aurousal, que es el nivel de activación cerebral. Implica tanto el ritmo de los procesos cerebrales como el nivel general de atención frente a los estímulos del medio y está regulado por el sistema de activación reticular. Puede variar desde un nivel de sobreactivación, como en el caso de emociones intensas o de estados de alerta, hasta un nivel atencional óptimo para la acción intencional, o hasta niveles de infra activación, como en el caso de estados de relajación o de sueño. - Valencias positivas y negativas. En el campo de la Psicología y, concretamente, en las emociones, una valencia positiva significa atractivo intrínseco, mientras que una valencia negativa implica aversión hacia un objeto, evento o situación. - Pupila: miosis y midriasis - EEG: frecuencias cerebrales alfa, beta, theta, gamma y delta. - Seguimiento de la mirada (eyetracking) donde se mide las coordenadas (x, y) del punto de atención de la mirada. En cuanto a los modelos de cálculo del lenguaje natural se ha tenido en cuenta los siguientes factores: amplitud, que es la fluctuación con que se mueve la voz; volumen, que es la intensidad de la voz medida en decibeles, y se puede se categorizar en fuerte o despacio; el tono que es la frecuencia de la onda que genera la voz con la cual se mueve en el espacio y es muy utilizado para rescatar las emociones con que se dicen las palabras; el timbre, que es la característica que puede verse más afectada, ya sea por un resfriado u otras enfermedades, y que genera que la voz se aprecia de forma más grave o más aguda, además, esta cualidad nos permite identificar dos fuentes sonoras diferentes; y el discurso, que es el contenido de la voz, es decir, lo que se está diciendo. Finalmente, los algoritmos de IA empleados (de forma no limitativa) y que ofrecieron mejores resultados en las pruebas son los algoritmos K-NN (K-Nearest Neighbours) , QDA (Quadratic Discriminant Analysis) , MPL (Múltiple Perception Layer) , SVM (Support Vector Machine) , DT (Decisión Tree) y RF (Random Forest) . La presente invención se configura como un método implementado por computador para la medición sincrónica de los estados cognitivos y emocionales del ser humano, de tal forma que las emociones y gestos son detectados en tiempo real mediante técnicas de visión artificial, interpretando el análisis del lenguaje natural para mejorar los resultados de la predicción. Este modelo de voz, a diferencia de otros, no se basa en la medición de frases completas, lo que provoca un bajo éxito en la medición, sino en la descomposición analítica de palabras y ílabas, haciendo un cálculo más preciso. Ya en referencia a las figuras, en la figura 1 se muestra un esquema del sistema que implementa la invención. El sistema comprende un procesador (41) ; una tarjeta gráfica (42) ; una entrada de captura de imágenes (43) mediante, por ejemplo, una cámara web; una salida de datos (44) mediante, por ejemplo, un monitor; un micrófono ambiental (45) ; una conexión de datos inalámbrica (46) ; y al menos una memoria (47) . El sistema se completa con un programa o programas que están almacenados en la memoria (47) y configurados para ejecutarse por el procesador (41) . Todo ello caracterizado porque los programas incluyen instrucciones que, cuando son ejecutadas por el procesador (41) hacen que el sistema ejecute las etapas de: (a) captura de datos de entrada; (b) filtrado de los datos de entrada; (c) procesado de los datos filtrados; (d) generación de los datos de salida; y (e) salida de datos. Estas etapas conforman el método objeto de la presente invención y se describen en detalle a continuación, con referencia a la figura 2. Primera etapa de captura de datos La invención, en primer lugar, captura los datos de (al menos) un individuo, aunque una de las importantes ventajas de esta invención es que es posible la captura de múltiples datos de múltiples individuos. Los datos que se captura de cada individuo son al menos una imagen (para lo que el sistema, lógicamente, comprende al menos un sensor de captura de imágenes) y al menos un fragmento de audio con un habla de dicho individuo. Mediante la cámara (43) y el micrófono (45) integrado en el hardware se detectan sujetos y se captura la información visual y evaluar sus estados emocionales y cognitivos (51) . Hay una captura de datos alternativa en remoto con dispositivos de terceros que dispongan de cámara y micrófono. Dichos sujetos recibirían un enlace para conectarse en remoto, dicha información de captura de datos sería recibida en el hardware de destino mediante conexión web (52) . Además, los datos visuales y sonoros son descargados de forma previa a su procesamiento y (a) se almacenan (53) ; o (b) son tratados en tiempo real, por lo que no se descargarían los datos de los individuos y se procesarían directamente (54) . Segunda etapa de filtrado de datos (55) Los datos obtenidos en la primera etapa deben filtrarse para asegurar una calidad óptima en la detección de estados emocionales, para eliminar aquellas imágenes que no alcanzan un mbral mínimo de calidad. Así pues, la presente Invención, sobre los datos capturados en la primera etapa, establece un doble filtrado: un primer filtrado mediante un primer algoritmo configurado para eliminar imágenes en las que no se reconozca un rostro de al menos un individuo o bien imágenes que tengan elementos que tapen o hacen indistinguibles los rasgos faciales. A modo de ejemplo no limitativo, los criterios de filtrado que se utilizan se basan en la presencia de reflejos o sombras, oscuridad o claridad y elementos que tapan el rostro, como pelo o gafas de sol. En la figura 3 se muestra un ejemplo de una imagen con un contraste excesivo entre el lado derecho e izquierdo de un rostro, que invalidaría su uso como imagen válida para la presente invención. A continuación del primer filtrado de la segunda etapa, se efectúa un segundo filtrado mediante un segundo algoritmo configurado para eliminar las imágenes que han superado el primer filtrado, es decir, aquellas imágenes en las que se ha detectado un rostro, pero no son válidas para su medición en base los siguientes criterios: posición, encuadre o giro de la imagen. Los parámetros de tamaño, tono, rotación vertical y horizontal del rostro son variables y predefinidos. En la figura 4 se muestra un ejemplo de imagen fuera del rango de medición, de tal forma que el rango de medición está definido por el recuadro grande y el rostro por el recuadro pequeño, observándose como éste último está parcialmente fuera del recuadro grande. Para el filtrado realizado se emplea un modelo de inteligencia artificial que fue creado para detectar qué imágenes de los rostros de los individuos están en un porcentaje mayor del 98% viendo una serie de estímulos que se están presentando en una pantalla. La forma en que se realizaron estos modelos de entrenamiento comprende más de 14 millones de imágenes de 45 mil individuos diferentes en más de 550 estudios, en donde se tiene la imagen de un rostro de un individuo junto con la información de donde está mirando (a modo de ejemplo no limitativo, mediante la tecnología de seguimiento de mirada -eyetracking- de la compañía Tobii, descrita en EP3800529A1) . Así pues, en la etapa de filtrado de la invención, cada imagen está etiquetada de forma no supervisada, ya que la presente invención implementa, en la etapa de filtrado, un algoritmo de visión artificial que, por medio de la localización de la posición del iris y la pupila en el ojo para identificar la ubicación de la mirada de la persona en la pantalla. Este algoritmo, a modo de ejemplo no limitativo, está descrito en [Pech Pacheco, José Luis & Álvarez-Borrego, Josué & Cristóbal, Gabriel & Keil, Matthias. (2003) . Automatic object identification irrespective to geometric changes. Optical Engineering. 42. 551-559. 10.1117/1.1531189]. Por tanto, con la dentificación de dónde está mirando cada individuo es posible calcular los puntos esenciales de cada rostro, lo que da como resultado las características de los diferentes grados de rotación vertical, horizontal y sobre su eje. Estos límites de grados de movimientos están determinados por un algoritmo de redes neuronales profundas convolucionadas, usado para el segundo filtrado y, de esta forma, emplear en posteriores etapas del método única y exclusivamente las imágenes que dan valor a la predicción de emociones, ya que la red profunda ha sido entrenada con rostros dentro de los mismos intervalos de rotación que los empleados para admitir o descartar imágenes. Tercera etapa de procesado de datos (56) En esta etapa los datos de las imágenes válidas obtenidas en la etapa anterior serán procesados junto con su equivalente de voz, si existiese. Cuarta etapa de generación de los datos de salida (57) En la cuarta etapa que implementa el método se genera un conjunto de datos interpretados tanto por cada individuo como por el conjunto agregado de todos los individuos y bloque de investigación. Los datos interpretados por individuo hacen referencia a disponer de resultados individuales y aislados de cada una de las personas evaluadas en un estudio, si son más de una. El conjunto agregado supone el tener un dato promedio de los resultados del conjunto de individuos de un mismo estudio. El dato agregado se extrae aplicando la media aritmética a los resultados de cada individuo con la excepción del dato "emoción predominante" y "tendencia emocional" en los que se aplica el cálculo de la moda. Concretamente, los datos de salida son: ira, asco, miedo, alegría, tristeza, sorpresa, neutral, anticipación, confianza, amor, sumisión, asombro, desaprobación, remordimiento, desprecio, agresividad, optimismo, culpabilidad, curiosidad, desesperación, incredulidad, envidia, cinismo, orgullo, esperanza, deleite, sentimentalismo, vergüenza, indignación, pesimismo, morbo, dominio, ansiedad, emoción predominante, tendencia emocional, veracidad, valencia positiva, valencia negativa, intensidad, enfoque, interés, rechazo, compromiso, confusión, comprensión, confianza, atención y estrés. Quinta etapa de salida de datos (58, 59) La invención genera tres salidas de datos que comprende: (a) datos en bruto, que contiene os datos descritos en la etapa anterior, agregados por individuo y por bloque de investigación; (b) datos de cliente, con datos finales, seleccionando aquellos útiles para ser expresados en gráficos e informes; (c) formato de gráficos que incluyen mapas de calor atencionales, gráficos y salida visual de datos con indicadores emocionales. Adicionalmente a los formatos de salida de datos anteriores, existe un generador de informe interpretado basado en la clasificación de las emociones por umbrales. Para validar el modelo computacional de la presente invención, se ha realizado un estudio comparativo entre la invención y dos modelos computacionales comerciales, como son FACET (de Paul Ekman, descrito, por ejemplo, en US 8, 416, 988 B2) y AFFECTIVA (de la compañía AFFECTIVA Inc.) . La aplicación FACET identifica alegría, tristeza, enfado, asco, miedo, sorpresa y neutralidad con 42 puntos de análisis (landmarks) en las imágenes. La aplicación AFFECTIVA identifica alegría, tristeza, enfado, asco, miedo, sorpresa, incredulidad, valencia positiva, valencia negativa, así como compromiso, con 67 puntos de análisis (landmarks) en las imágenes. Sin embargo, la presente invención identifica hasta 790 puntos de análisis (landmarks) en las imágenes y permite detectar las siguientes emociones: ira, asco, miedo, alegría, tristeza, sorpresa, neutral, anticipación, confianza, amor, sumisión, asombro, desaprobación, remordimiento, desprecio, agresividad, optimismo, culpabilidad, curiosidad, desesperación, incredulidad, envidia, cinismo, orgullo, esperanza, deleite, sentimentalismo, vergüenza, indignación, pesimismo, morbo, dominio, ansiedad, emoción predominante, tendencia emocional, veracidad, valencia positiva, valencia negativa, intensidad, enfoque, interés, rechazo, compromiso, confusión, comprensión, confianza, atención y estrés. Respecto del mismo estímulo hacia el individuo, se ha realizado un estudio comparativo con las tres tecnologías indicadas (INVENCIÓN, FACET, AFFECTIVA) respectivamente, gráfica izquierda, centro y derecha en las figuras 5 y 6, observándose que cada uno de ellos proporciona resultados diferentes, pero de donde se pueden extraer las siguientes conclusiones: - La invención muestra una mayor sensibilidad ante la medición de las emociones básicas, mientras que AFFECTIVA muestra una escasa variabilidad, no llegando a superar el 0, 5/100 en ningún momento de la medición (figura 5) - La invención muestra una mayor sensibilidad ante la medición de valencias positivas y negativas, mientas que FACET muestra un nivel de sensibilidad medio y AFFECTIVA o muestra ninguna variación en la valencia (figura 6) Con estos ensayos se confirma que parte del éxito de la eficacia de los modelos de precisión se basa en la calidad de los datos de entrenamiento de la IA, tal y como se muestra en la figura 7, obtenidos a través de la neurociencia y sin sesgos humanos de etiquetación e interpretación emocional, porque la invención tiene mayor sensibilidad en las direcciones emocionales y, en consecuencia, en la identificación de emociones básicas. Así pues, toca destacar que los datos de entrenamiento de la IA son datos recabados con diferentes tecnologías como: electroencefalografía, respuesta galvánica de la piel (GSR) , reconocimiento de expresiones faciales, pupilometría, electromiografía y seguimiento de la mirada utilizando distintos métodos de medición. En definitiva, la presente invención resuelve varios problemas técnicos. El primer y principal problema técnico resuelto por la invención es el de la baja eficiencia en la medición. El modelo de cálculo de la presente invención está basado en varias capas de cálculo de IA entrenadas que compiten entre ellas para auto-comparar resultados y obtener así mejores resultados de forma contrastada. No obstante, esto no hace que los requisitos de HW y SW sean altos, lo que facilita que la presente invención pueda integrarse en sistemas de terceros. Además, es un sistema masivo, ya que puede detectar y medir a más de una persona al mismo tiempo, lo que facilita una monitorización en tiempo real de los resultados. Otro aspecto importante de la invención es la anonimización de los datos, ya que es posible procesar la información emocional y atencional de los rostros directamente, sin grabar ninguna imagen o dato personal de ningún individuo.

Publicaciones:

ES2957419 (18/01/2024) - A1 Solicitud de patente con informe sobre el estado de la técnica

Eventos:

En fecha 03/06/2022 se realizó Registro Instancia de Solicitud

En fecha 06/06/2022 se realizó Admisión a Trámite

En fecha 06/06/2022 se realizó 1001P_Comunicación Admisión a Trámite

En fecha 17/06/2022 se realizó Concesión solicitud de reducción de tasas

En fecha 21/06/2022 se realizó Superado examen de oficio

En fecha 23/06/2022 se realizó Publicación concesión reducción de tasas

En fecha 01/12/2022 se realizó Realizado IET

En fecha 05/12/2022 se realizó 1109P_Comunicación Traslado del IET

En fecha 18/01/2024 se realizó Publicación Solicitud

En fecha 18/01/2024 se realizó Publicación Folleto Solicitud con IET (A1)

Pagos:

02/06/2022 - Pago Tasas IET

+ ES-2957419_A11. Un método implementado por computador de detección en tiempo real de estados emocionales mediante visión artificial y escucha del lenguaje natural que comprende: una primera etapa de captura de datos, donde dichos datos comprenden al menos una imagen de un individuo y al menos un fragmento de audio de un habla de dicho individuo; una segunda etapa de filtrado de los datos capturados en la primera etapa y que comprende, a su vez: un primer filtrado configurado para eliminar imágenes sin rostro o con elementos que tapen o hagan indistinguibles los rasgos faciales; y un segundo filtrado configurado para eliminar imágenes descuadradas o con una postura inadecuada para su medición; una tercera etapa de procesado de las imágenes válidas obtenidas en la segunda etapa de filtrado; una cuarta etapa de generación de datos configurada para obtener al menos un conjunto de datos interpretados tanto por individuo como el conjunto agregado de todos los individuos y bloque de investigación; y una quinta etapa de salida de datos. 2. El método de acuerdo con la reivindicación 1 donde la etapa de captura de datos puede realizarse en local o en remoto mediante un enlace de conexión web. 3. El método de acuerdo con la reivindicación 1 donde los datos capturados en la primera etapa pueden ser descargados y almacenados en una memoria de forma previa a su procesamiento, o bien pueden ser procesados directamente en tiempo real, sin descarga o almacenamiento previo. 4. El método de acuerdo con la reivindicación 1 donde las imágenes válidas y las imágenes descartadas en la segunda etapa de filtrado se almacenan en ubicaciones diferenciadas dentro de la memoria. 5. Un sistema de detección en tiempo real de estados emocionales mediante visión artificial y escucha del lenguaje natural que comprende: un procesador; una tarjeta gráfica; una entrada de captura de imágenes; una salida de datos; un micrófono ambiental; al menos una memoria; y un programa o programas que están almacenados en la memoria y configurados para ejecutarse por el procesador, caracterizado porque los programas incluyen Instrucciones que, cuando son ejecutadas por el procesador (41) hacen que el sistema ejecute el método de acuerdo con una cualquiera de las reivindicaciones 1 a 4. 6. Un producto de programa informático con instrucciones configuradas para su ejecución por uno o más procesadores que, cuando son ejecutadas por el sistema de la reivindicación 5 hacen que lleve a cabo el método según cualquiera de las reivindicaciones 1 a 4.

Los productos y servicios protegidos por este registro son:

G06V 40/16 - G10L 25/63

Descripciones:

+ ES-2957419_A1 Sistema y método de detección en tiempo real de estados emocionales mediante visión artificial y escucha del lenguaje natural Campo técnico La presente invención está referida a un sistema y un método de detección en tiempo real de estados emocionales mediante visión artificial y escucha del lenguaje natural, que tiene como propósito investigar y desarrollar soluciones basadas en la neurociencia para entender al ser humano y proporcionar un conocimiento profundo de sus emociones, comportamiento, actitudes, estado de ánimo y toma de decisiones. Estado de la técnica anterior En la actualidad, son conocidas diversos métodos de investigación del comportamiento y preferencias de los consumidores mediante metodologías y tecnologías venidas de la neurociencia, entre los que destacan el desarrollo de numerosos estudios de neuromarketing utilizando aparatos de medición biométrica y de actividad mental. Estos estudios suelen resultar lentos y caros debido a que la investigación de los sujetos debe realizarse persona a persona y a que se debe conectar manualmente a cada una de estas personas estudiadas a las diferentes tecnologías, así como realizarlas sin ningún tipo de anonimato lo que podría provocar un sesgo intrusivo en las mismas. Por un lado, encontramos la patente americana US 9 141 604 B2, una tecnología de evaluación de las emociones humanas - sistema y método - que describe un método novedoso de análisis y presentación de resultados de la emoción humana durante una sesión como chat, vídeo, audio y combinación de los mismos en tiempo real. El análisis se realiza mediante el análisis semiótico y la agrupación jerárquica de pendientes para dar retroalimentación para una sesión o sesiones históricas al usuario o a cualquier profesional. El método y el sistema son útiles para reconocer la reacción para una sesión particular o la detección de un comportamiento anormal. El método y sistema con algoritmo único es útil para obtener una retroalimentación instantánea para mantener el rumbo o cambiar de estrategia para un resultado deseado durante la sesión. Así mismo, la patente americana US 2010/0325078 A1, un dispositivo y método para reconocer la emoción y la intención de un usuario donde se proporciona un dispositivo y un método de reconocimiento de la intención del usuario. El dispositivo de reconocimiento de la intención del usuario puede ser utilizado por una persona que no es capaz de expresar adecuadamente su emoción e intención, como una persona discapacitada, un paciente, y similares. El dispositivo de reconocimiento de la intención del usuario puede determinar una emoción del usuario basada en la información de comunicación del usuario, y también, puede determinar una intención del usuario basada en la emoción y la información biométrica del usuario. El dispositivo de reconocimiento de la intención del usuario puede proporcionar una salida apropiada correspondiente a la intención determinada del usuario. La patente americana US 7827 126 B2, un método para cambiar la emoción del robot de software donde se divulga un método para cambiar la emoción de un robot de software ("sobot") en un terminal de "sobot". El terminal de "sobot" incluye una unidad de memoria a corto plazo y una unidad de memoria a largo plazo. Cuando se produce un cambio emocional durante el funcionamiento de la unidad de memoria a corto plazo, el terminal de "sobot" almacena un valor de emoción de referencia a corto plazo de la emoción correspondiente en la memoria de referencia a largo plazo. Cuando transcurre el tiempo de funcionamiento de la unidad de memoria a largo plazo, el terminal de "sobot" restablece el valor de emoción de referencia a largo plazo utilizando los valores de emoción de referencia a corto plazo almacenados en la unidad de memoria a largo plazo. El terminal de "sobot" puede cambiar la emoción del "sobot" de forma más natural a través del proceso anterior. La patente americana US 8214214 B2, un dispositivo y método de detección de emociones para su uso en sistemas distribuidos que consiste en un analizador de prosodia que mejora la interpretación de los enunciados del lenguaje natural. El analizador está distribuido en una arquitectura cliente/servidor, de modo que el alcance de las tareas de procesamiento de reconocimiento de emociones puede asignarse de forma dinámica en función de los recursos de procesamiento, las condiciones del canal, la carga del cliente, etc. Los datos prosódicos parcialmente procesados pueden enviarse por separado o combinarse con otros datos del habla del dispositivo cliente y transmitirse a un servidor para obtener una respuesta en tiempo real. El entrenamiento del analizador de prosodia con las respuestas esperadas en el mundo real mejora el modelado de las emociones y la identificación en tiempo real de posibles características como el énfasis, la intención, la actitud y el significado semántico en los enunciados del hablante. La solicitud internacional WO 02/41191 A1, un método y aparato para analizar el afecto y la emoción en el texto donde se presenta un método asistido por ordenador para clasificar un documento de texto según la emoción y el afecto. Se asigna una puntuación a cada término de afecto en el documento. Se calcula una puntuación de afecto para el documento a partir de las puntuaciones de cada término de afecto. El documento se clasifica entonces de acuerdo con la puntuación de afecto. También se divulga un aparato para realizar el método asistido por ordenador. La solicitud internacional WO 02/067194 A2, un sistema de modelización y simulación de estados emocionales, que incluye (a) la tabla de emociones Placer-Arousal-Dominancia (PAD) que hace posible (b) convertir los términos de emoción a sus respectivos valores PAD, (c) una fórmula para trabajar hacia atrás desde cualquier conjunto específico de valores PAD para derivar un único término de emoción que se ajuste mejor a esa combinación particular de valores PAD, (d) una fórmula para calcular la distancia entre un conjunto preseleccionado de valores PAD y el término de emoción más cercano que se ajusta a esos valores PAD, (e) un método para calcular la respuesta emocional media de un grupo a cualquier situación o estímulo, permitiendo así la derivación de un único término de emoción que represente mejor la experiencia emocional media del grupo, (f) un procedimiento genérico para derivar términos de emoción de modelos estadísticos multidimensionales. La presente invención se utiliza como simulador de emociones, especialmente en el campo de los sistemas de bucle cerrado y abierto, como un sistema de calefacción, para representar el funcionamiento del sistema. La invención americana US 7 451 079, un método y dispositivo de reconocimiento de emociones donde el reconocimiento de emociones se realiza extrayendo un conjunto que comprende al menos una característica derivada de una señal, y procesando el conjunto de características extraídas para detectar una emoción a partir de ellas. La señal de voz se filtra a paso bajo antes de extraer de ella al menos una característica del conjunto. La frecuencia de corte para el filtrado de paso bajo se centra típicamente alrededor de 250 Hz. Las características son, por ejemplo, cantidades estadísticas extraídas del muestreo de una señal de la intensidad o el tono de la señal de voz. La solicitud internacional WO 2016/014321 A1, un reconocimiento de emociones en tiempo real a partir de señales de audio donde se proporcionan sistemas, métodos y medios de almacenamiento legibles por ordenador para reconocer emociones en señales de audio en tiempo real. Se detecta una señal de audio y se calcula una huella digital de audio rápida en el dispositivo informático de un usuario. Una o más características se extraen de la huella igital de audio y se comparan con las características asociadas con las emociones definidas para determinar los grados relativos de similitud. Las puntuaciones de confianza se calculan para las emociones definidas basándose en los grados relativos de similitud y se determina si una puntuación de confianza para una o más emociones particulares supera una puntuación de confianza umbral. Si se determina que la puntuación de confianza del umbral para una o más emociones particulares se excede, la emoción o emociones particulares se asocian con la señal de audio. Si se desea, se pueden iniciar varias acciones basadas en la emoción o emociones asociadas a la señal de audio. Por último, la patente americana US 8364395 B2, una medición de las emociones humanas en los planes y mapas de navegación que consiste en un sistema de navegación mejorado que permite planificar la ruta de navegación y el destino según los criterios especificados por el usuario para el estado emocional de las personas a lo largo de la ruta, en el destino, o en ambos. La mejora se lleva a cabo recibiendo un conjunto de métricas de emoción humana correspondientes a una o más partes de un plan de navegación; determinando si las métricas de emoción humana cumplen uno o más criterios especificados por el usuario; respondiendo a que no se cumplan los criterios, determinando un plan de navegación alternativo hasta que se cumplan los criterios especificados por el usuario; y en respuesta al cumplimiento de los criterios, presentar el plan de navegación al usuario para su colocación en un sistema de navegación y, opcionalmente, durante la ejecución del plan de navegación, actualizar las métricas de emoción humana recibidas; repetir la determinación en función de los criterios especificados por el usuario; y repetir los pasos de determinación de un plan de navegación alternativo y la presentación a un usuario en respuesta a las métricas de emoción humana actualizadas que no cumplen los criterios especificados por el usuario. Por tanto, podemos observar como todas las invenciones arriba citadas aportan soluciones parciales de baja precisión y por separado. El objetivo de la invención aquí presentada mediante sus reivindicaciones es un sistema de hardware y su método, que detectan mediante webcam, escucha mediante micrófono integrado y procesa con un software que unifica todos los sistemas de medición por imagen de expresiones, gestos y lenguaje natural con un grado de eficacia y precisión superior, permitiendo así evaluar masivamente y de modo escalado los estados emocionales de los individuos sin mermar la posible calidad de los resultados, sin realizarse de un modo intrusivo y con una tecnología asequible, sencilla y manejable fácilmente por cualquiera que además pudiese aportar resultados sin necesidad de tener conocimientos en la materia. Explicación de la invención Es un objeto de la presente invención un método implementado por computador configurado para la detección en tiempo real de estados emocionales mediante visión artificial y escucha del lenguaje natural que comprende: (a) una primera etapa de captura de datos, donde dichos datos comprenden al menos una imagen de un individuo y al menos un fragmento de audio de un habla de dicho individuo; (b) una segunda etapa de filtrado de los datos capturados en la primera etapa y que comprende, a su vez: (b.1) un primer filtrado configurado para eliminar imágenes sin rostro o con elementos que tapen o hagan indistinguibles los rasgos faciales; y (b.2) un segundo filtrado configurado para eliminar imágenes descuadradas o con una postura inadecuada para su medición; (c) una tercera etapa de procesado de las imágenes válidas obtenidas en la segunda etapa de filtrado; (d) una cuarta etapa de generación de datos configurada para obtener al menos un conjunto de datos interpretados tanto por individuo como el conjunto agregado de todos los individuos y bloque de investigación; y (e) una quinta etapa de salida de datos. Gracias a su diseño, podemos obtener un sistema que engloba diferentes capas de inteligencia artificial convolucionadas que identifique, procese, interprete y comprenda rasgos complejos de la comunicación humana a través de la imagen y el sonido para la extracción de señales fisiológicas y cerebrales que identifiquen el estado de ánimo, estrés, lenguaje no verbal, veracidad del discurso y ofrecer una respuesta empática en consonancia a las personas a través de la visión artificial. Así, dicho sistema conseguirá descifrar las emociones creando algoritmos de reconocimiento del habla, de la voz, del lenguaje no verbal, de las emociones, del estado de ánimo. Dicho sistema está basado en la inteligencia artificial no intrusiva, lo que permite moldear aplicaciones de mercado y dotarlas con inmensas posibilidades. Una de las ventajas de dicho sistema es la posibilidad de potenciar la capacidad de conciencia del ser humano para lograr sus necesidades y deseos más importantes a través de una Red Neuronal que supera la inteligencia probada y aporta el conocimiento que proviene de una innovación tecnológica para superar la comprensión del ser humano en sus emociones, comportamiento, actitudes, estado de ánimo y toma de decisiones. Para ello, el sistema dispone de varios tipos de detectores que sirven de base del modelo de cálculo como puntos de control de los músculos faciales, gestos, ángulo, apertura/cierre de ojos y boca, cejas, el discurso hablado, etc. Este modelo de cálculo permitirá desarrollar oluciones para que las máquinas y cualquier otra tecnología puedan detectar emociones en los seres humanos, darles una nueva capa de entendimiento que permita realizar tareas y soluciones más complejas y cercanas a los intereses del ser humano y por otro lado servirá para tener un conocimiento más profundo del estado mental, riesgos, preferencias y toma de decisiones de las personas. Así mismo, partiendo de que el objetivo primario es detectar y entender las emociones, estados de ánimo y comportamiento de las personas, el sistema el sistema es capaz de detecta y medir, también, emociones, comportamientos, estados mentales, ansiedad, estrés, amenazas, discursos engañosos, así como otros indicadores claves y la predicción y recreación de dichos estados. Estos puntos son claves a la hora de entender tomas de decisiones, estados emocionales potencialmente peligrosos, intereses y aprendizajes de contenidos educativos y de publicidad, estados de estrés en diferentes situaciones que puedan entrañar un peligro de seguridad o bien un bajo rendimiento, así como un primer indicador para una enfermedad mental y/o física. Por lo tanto, dicho conocimiento permite desarrollar diferentes aplicaciones sobre una misma base de desarrollo que es el objeto de esta patente: investigación de mercado, comunicación, espectáculos, entretenimiento, seguridad, ciudades inteligentes, robots, domótica, juegos de azar-apuestas, seguridad en la conducción, IOT (internet de las cosas) , educación, recursos humanos, seguridad laboral, video llamadas, eventos masivos, procesos industriales, controles de calidad, política, ciberseguridad, entre otros. Breve descripción de los dibujos A continuación, se pasa a describir de manera muy breve una serie de dibujos que ayudan a comprender mejor la invención y que se relacionan expresamente con una realización de dicha invención, que se ilustra como un ejemplo no limitativo de ésta. La FIG.1 muestra un diagrama del sistema de detección en tiempo real de estados emocionales mediante visión artificial y escucha del lenguaje natural, objeto de la presente invención. La FIG.2 muestra un diagrama de bloques del método de detección en tiempo real de estados emocionales mediante visión artificial y escucha del lenguaje natural, objeto de la presente invención. La FIG.3 muestra un ejemplo de una imagen de un rostro de un individuo, donde se observa un excesivo contraste de iluminación entre el lado derecho e izquierdo, lo que invalidaría su uso como imagen válida tras el primer filtrado. La FIG.4 muestra un ejemplo de una imagen de un rostro de un individuo, donde se observa una imagen fuera del rango de medición, lo que invalidaría su uso como imagen válida tras el segundo filtrado. La FIG.5 muestra una primera gráfica comparativa entre la invención y los sistemas FACET y AFFECTIVA del estado de la técnica. La FIG.6 muestra una segunda gráfica comparativa entre la invención y los sistemas FACET y AFFECTIVA del estado de la técnica. La FIG.7 muestra un diagrama de los datos usados para el entrenamiento de la IA de la invención. Explicación de un modo detallado de realización de la invención Tal y como se ha indicado previamente, es un objeto de la presente invención un sistema y un método configurado para la detección e interpretación de las emociones de un ser humano. Para ello, se implementa un sistema y un modelo computacional que permite diferenciar emociones como son: ira, asco, miedo, alegría, tristeza, sorpresa, neutral, anticipación, confianza, amor, sumisión, asombro, desaprobación, remordimiento, desprecio, agresividad, optimismo, culpabilidad, curiosidad, desesperación, incredulidad, envidia, cinismo, orgullo, esperanza, deleite, sentimentalismo, vergüenza, indignación, pesimismo, morbo, dominio, ansiedad, predominante, tendencia, veracidad, valencia positiva, valencia negativa, intensidad, enfoque, interés, rechazo, compromiso, confusión, comprensión, confianza, atención y estrés. En definitiva, la presente invención está basada en metodologías propias de la neurociencia. Dichas metodologías han sido aplicadas obteniendo información biométrica y de actividad cerebral de miles de sujetos que sirve como base para crear nuevos modelos de cálculo basados en IA (Inteligencia Artificial) como ML y DL (Machine Learning y Deep Learning respectivamente) . En la presente invención se han tenido en cuentas bases de datos de más e 40.000 individuos con los siguientes datos de entrenamiento de la IA, que incluyen, de forma no limitativa: - Alegría, tristeza, enfado, sorpresa, asco, rechazo y neutralidad. - Nivel aurousal, que es el nivel de activación cerebral. Implica tanto el ritmo de los procesos cerebrales como el nivel general de atención frente a los estímulos del medio y está regulado por el sistema de activación reticular. Puede variar desde un nivel de sobreactivación, como en el caso de emociones intensas o de estados de alerta, hasta un nivel atencional óptimo para la acción intencional, o hasta niveles de infra activación, como en el caso de estados de relajación o de sueño. - Valencias positivas y negativas. En el campo de la Psicología y, concretamente, en las emociones, una valencia positiva significa atractivo intrínseco, mientras que una valencia negativa implica aversión hacia un objeto, evento o situación. - Pupila: miosis y midriasis - EEG: frecuencias cerebrales alfa, beta, theta, gamma y delta. - Seguimiento de la mirada (eyetracking) donde se mide las coordenadas (x, y) del punto de atención de la mirada. En cuanto a los modelos de cálculo del lenguaje natural se ha tenido en cuenta los siguientes factores: amplitud, que es la fluctuación con que se mueve la voz; volumen, que es la intensidad de la voz medida en decibeles, y se puede se categorizar en fuerte o despacio; el tono que es la frecuencia de la onda que genera la voz con la cual se mueve en el espacio y es muy utilizado para rescatar las emociones con que se dicen las palabras; el timbre, que es la característica que puede verse más afectada, ya sea por un resfriado u otras enfermedades, y que genera que la voz se aprecia de forma más grave o más aguda, además, esta cualidad nos permite identificar dos fuentes sonoras diferentes; y el discurso, que es el contenido de la voz, es decir, lo que se está diciendo. Finalmente, los algoritmos de IA empleados (de forma no limitativa) y que ofrecieron mejores resultados en las pruebas son los algoritmos K-NN (K-Nearest Neighbours) , QDA (Quadratic Discriminant Analysis) , MPL (Múltiple Perception Layer) , SVM (Support Vector Machine) , DT (Decisión Tree) y RF (Random Forest) . La presente invención se configura como un método implementado por computador para la medición sincrónica de los estados cognitivos y emocionales del ser humano, de tal forma que las emociones y gestos son detectados en tiempo real mediante técnicas de visión artificial, interpretando el análisis del lenguaje natural para mejorar los resultados de la predicción. Este modelo de voz, a diferencia de otros, no se basa en la medición de frases completas, lo que provoca un bajo éxito en la medición, sino en la descomposición analítica de palabras y ílabas, haciendo un cálculo más preciso. Ya en referencia a las figuras, en la figura 1 se muestra un esquema del sistema que implementa la invención. El sistema comprende un procesador (41) ; una tarjeta gráfica (42) ; una entrada de captura de imágenes (43) mediante, por ejemplo, una cámara web; una salida de datos (44) mediante, por ejemplo, un monitor; un micrófono ambiental (45) ; una conexión de datos inalámbrica (46) ; y al menos una memoria (47) . El sistema se completa con un programa o programas que están almacenados en la memoria (47) y configurados para ejecutarse por el procesador (41) . Todo ello caracterizado porque los programas incluyen instrucciones que, cuando son ejecutadas por el procesador (41) hacen que el sistema ejecute las etapas de: (a) captura de datos de entrada; (b) filtrado de los datos de entrada; (c) procesado de los datos filtrados; (d) generación de los datos de salida; y (e) salida de datos. Estas etapas conforman el método objeto de la presente invención y se describen en detalle a continuación, con referencia a la figura 2. Primera etapa de captura de datos La invención, en primer lugar, captura los datos de (al menos) un individuo, aunque una de las importantes ventajas de esta invención es que es posible la captura de múltiples datos de múltiples individuos. Los datos que se captura de cada individuo son al menos una imagen (para lo que el sistema, lógicamente, comprende al menos un sensor de captura de imágenes) y al menos un fragmento de audio con un habla de dicho individuo. Mediante la cámara (43) y el micrófono (45) integrado en el hardware se detectan sujetos y se captura la información visual y evaluar sus estados emocionales y cognitivos (51) . Hay una captura de datos alternativa en remoto con dispositivos de terceros que dispongan de cámara y micrófono. Dichos sujetos recibirían un enlace para conectarse en remoto, dicha información de captura de datos sería recibida en el hardware de destino mediante conexión web (52) . Además, los datos visuales y sonoros son descargados de forma previa a su procesamiento y (a) se almacenan (53) ; o (b) son tratados en tiempo real, por lo que no se descargarían los datos de los individuos y se procesarían directamente (54) . Segunda etapa de filtrado de datos (55) Los datos obtenidos en la primera etapa deben filtrarse para asegurar una calidad óptima en la detección de estados emocionales, para eliminar aquellas imágenes que no alcanzan un mbral mínimo de calidad. Así pues, la presente Invención, sobre los datos capturados en la primera etapa, establece un doble filtrado: un primer filtrado mediante un primer algoritmo configurado para eliminar imágenes en las que no se reconozca un rostro de al menos un individuo o bien imágenes que tengan elementos que tapen o hacen indistinguibles los rasgos faciales. A modo de ejemplo no limitativo, los criterios de filtrado que se utilizan se basan en la presencia de reflejos o sombras, oscuridad o claridad y elementos que tapan el rostro, como pelo o gafas de sol. En la figura 3 se muestra un ejemplo de una imagen con un contraste excesivo entre el lado derecho e izquierdo de un rostro, que invalidaría su uso como imagen válida para la presente invención. A continuación del primer filtrado de la segunda etapa, se efectúa un segundo filtrado mediante un segundo algoritmo configurado para eliminar las imágenes que han superado el primer filtrado, es decir, aquellas imágenes en las que se ha detectado un rostro, pero no son válidas para su medición en base los siguientes criterios: posición, encuadre o giro de la imagen. Los parámetros de tamaño, tono, rotación vertical y horizontal del rostro son variables y predefinidos. En la figura 4 se muestra un ejemplo de imagen fuera del rango de medición, de tal forma que el rango de medición está definido por el recuadro grande y el rostro por el recuadro pequeño, observándose como éste último está parcialmente fuera del recuadro grande. Para el filtrado realizado se emplea un modelo de inteligencia artificial que fue creado para detectar qué imágenes de los rostros de los individuos están en un porcentaje mayor del 98% viendo una serie de estímulos que se están presentando en una pantalla. La forma en que se realizaron estos modelos de entrenamiento comprende más de 14 millones de imágenes de 45 mil individuos diferentes en más de 550 estudios, en donde se tiene la imagen de un rostro de un individuo junto con la información de donde está mirando (a modo de ejemplo no limitativo, mediante la tecnología de seguimiento de mirada -eyetracking- de la compañía Tobii, descrita en EP3800529A1) . Así pues, en la etapa de filtrado de la invención, cada imagen está etiquetada de forma no supervisada, ya que la presente invención implementa, en la etapa de filtrado, un algoritmo de visión artificial que, por medio de la localización de la posición del iris y la pupila en el ojo para identificar la ubicación de la mirada de la persona en la pantalla. Este algoritmo, a modo de ejemplo no limitativo, está descrito en [Pech Pacheco, José Luis & Álvarez-Borrego, Josué & Cristóbal, Gabriel & Keil, Matthias. (2003) . Automatic object identification irrespective to geometric changes. Optical Engineering. 42. 551-559. 10.1117/1.1531189]. Por tanto, con la dentificación de dónde está mirando cada individuo es posible calcular los puntos esenciales de cada rostro, lo que da como resultado las características de los diferentes grados de rotación vertical, horizontal y sobre su eje. Estos límites de grados de movimientos están determinados por un algoritmo de redes neuronales profundas convolucionadas, usado para el segundo filtrado y, de esta forma, emplear en posteriores etapas del método única y exclusivamente las imágenes que dan valor a la predicción de emociones, ya que la red profunda ha sido entrenada con rostros dentro de los mismos intervalos de rotación que los empleados para admitir o descartar imágenes. Tercera etapa de procesado de datos (56) En esta etapa los datos de las imágenes válidas obtenidas en la etapa anterior serán procesados junto con su equivalente de voz, si existiese. Cuarta etapa de generación de los datos de salida (57) En la cuarta etapa que implementa el método se genera un conjunto de datos interpretados tanto por cada individuo como por el conjunto agregado de todos los individuos y bloque de investigación. Los datos interpretados por individuo hacen referencia a disponer de resultados individuales y aislados de cada una de las personas evaluadas en un estudio, si son más de una. El conjunto agregado supone el tener un dato promedio de los resultados del conjunto de individuos de un mismo estudio. El dato agregado se extrae aplicando la media aritmética a los resultados de cada individuo con la excepción del dato "emoción predominante" y "tendencia emocional" en los que se aplica el cálculo de la moda. Concretamente, los datos de salida son: ira, asco, miedo, alegría, tristeza, sorpresa, neutral, anticipación, confianza, amor, sumisión, asombro, desaprobación, remordimiento, desprecio, agresividad, optimismo, culpabilidad, curiosidad, desesperación, incredulidad, envidia, cinismo, orgullo, esperanza, deleite, sentimentalismo, vergüenza, indignación, pesimismo, morbo, dominio, ansiedad, emoción predominante, tendencia emocional, veracidad, valencia positiva, valencia negativa, intensidad, enfoque, interés, rechazo, compromiso, confusión, comprensión, confianza, atención y estrés. Quinta etapa de salida de datos (58, 59) La invención genera tres salidas de datos que comprende: (a) datos en bruto, que contiene os datos descritos en la etapa anterior, agregados por individuo y por bloque de investigación; (b) datos de cliente, con datos finales, seleccionando aquellos útiles para ser expresados en gráficos e informes; (c) formato de gráficos que incluyen mapas de calor atencionales, gráficos y salida visual de datos con indicadores emocionales. Adicionalmente a los formatos de salida de datos anteriores, existe un generador de informe interpretado basado en la clasificación de las emociones por umbrales. Para validar el modelo computacional de la presente invención, se ha realizado un estudio comparativo entre la invención y dos modelos computacionales comerciales, como son FACET (de Paul Ekman, descrito, por ejemplo, en US 8, 416, 988 B2) y AFFECTIVA (de la compañía AFFECTIVA Inc.) . La aplicación FACET identifica alegría, tristeza, enfado, asco, miedo, sorpresa y neutralidad con 42 puntos de análisis (landmarks) en las imágenes. La aplicación AFFECTIVA identifica alegría, tristeza, enfado, asco, miedo, sorpresa, incredulidad, valencia positiva, valencia negativa, así como compromiso, con 67 puntos de análisis (landmarks) en las imágenes. Sin embargo, la presente invención identifica hasta 790 puntos de análisis (landmarks) en las imágenes y permite detectar las siguientes emociones: ira, asco, miedo, alegría, tristeza, sorpresa, neutral, anticipación, confianza, amor, sumisión, asombro, desaprobación, remordimiento, desprecio, agresividad, optimismo, culpabilidad, curiosidad, desesperación, incredulidad, envidia, cinismo, orgullo, esperanza, deleite, sentimentalismo, vergüenza, indignación, pesimismo, morbo, dominio, ansiedad, emoción predominante, tendencia emocional, veracidad, valencia positiva, valencia negativa, intensidad, enfoque, interés, rechazo, compromiso, confusión, comprensión, confianza, atención y estrés. Respecto del mismo estímulo hacia el individuo, se ha realizado un estudio comparativo con las tres tecnologías indicadas (INVENCIÓN, FACET, AFFECTIVA) respectivamente, gráfica izquierda, centro y derecha en las figuras 5 y 6, observándose que cada uno de ellos proporciona resultados diferentes, pero de donde se pueden extraer las siguientes conclusiones: - La invención muestra una mayor sensibilidad ante la medición de las emociones básicas, mientras que AFFECTIVA muestra una escasa variabilidad, no llegando a superar el 0, 5/100 en ningún momento de la medición (figura 5) - La invención muestra una mayor sensibilidad ante la medición de valencias positivas y negativas, mientas que FACET muestra un nivel de sensibilidad medio y AFFECTIVA o muestra ninguna variación en la valencia (figura 6) Con estos ensayos se confirma que parte del éxito de la eficacia de los modelos de precisión se basa en la calidad de los datos de entrenamiento de la IA, tal y como se muestra en la figura 7, obtenidos a través de la neurociencia y sin sesgos humanos de etiquetación e interpretación emocional, porque la invención tiene mayor sensibilidad en las direcciones emocionales y, en consecuencia, en la identificación de emociones básicas. Así pues, toca destacar que los datos de entrenamiento de la IA son datos recabados con diferentes tecnologías como: electroencefalografía, respuesta galvánica de la piel (GSR) , reconocimiento de expresiones faciales, pupilometría, electromiografía y seguimiento de la mirada utilizando distintos métodos de medición. En definitiva, la presente invención resuelve varios problemas técnicos. El primer y principal problema técnico resuelto por la invención es el de la baja eficiencia en la medición. El modelo de cálculo de la presente invención está basado en varias capas de cálculo de IA entrenadas que compiten entre ellas para auto-comparar resultados y obtener así mejores resultados de forma contrastada. No obstante, esto no hace que los requisitos de HW y SW sean altos, lo que facilita que la presente invención pueda integrarse en sistemas de terceros. Además, es un sistema masivo, ya que puede detectar y medir a más de una persona al mismo tiempo, lo que facilita una monitorización en tiempo real de los resultados. Otro aspecto importante de la invención es la anonimización de los datos, ya que es posible procesar la información emocional y atencional de los rostros directamente, sin grabar ninguna imagen o dato personal de ningún individuo.

Publicaciones:

ES2957419 (18/01/2024) - A1 Solicitud de patente con informe sobre el estado de la técnica

Eventos:

En fecha 03/06/2022 se realizó Registro Instancia de Solicitud

En fecha 06/06/2022 se realizó Admisión a Trámite

En fecha 06/06/2022 se realizó 1001P_Comunicación Admisión a Trámite

En fecha 17/06/2022 se realizó Concesión solicitud de reducción de tasas

En fecha 21/06/2022 se realizó Superado examen de oficio

En fecha 23/06/2022 se realizó Publicación concesión reducción de tasas

En fecha 01/12/2022 se realizó Realizado IET

En fecha 05/12/2022 se realizó 1109P_Comunicación Traslado del IET

En fecha 18/01/2024 se realizó Publicación Solicitud

En fecha 18/01/2024 se realizó Publicación Folleto Solicitud con IET (A1)

Pagos:

02/06/2022 - Pago Tasas IET

Fuente de la información

Parte de la información aquí publicada es pública puesto que ha sido obtenida de la Oficina de Propiedad Industrial de los diferentes países el 27/04/2024 y por lo tanto puede ser que la información no esté actualizada.Parte de la información aquí mostrada ha sido calculada por nuestro sistema informático y puede no ser veraz.

Privacidad

Si considera que al información aquí publicada afecta a su privacidad y desea que eliminemos la información aquí publicada envíe un email a info@patentes-y-marcas.com o rellene el formulario que encontrará aquí.Información sobre el registro de patente nacional por Sistema y método de detección en tiempo real de estados emocionales mediante visión artificial y escucha del lenguaje natural con el número P202230488

El registro de patente nacional por Sistema y método de detección en tiempo real de estados emocionales mediante visión artificial y escucha del lenguaje natural con el número P202230488 fue solicitada el 03/06/2022. Se trata de un registro en España por lo que este registro no ofrece protección en el resto de países. El registro Sistema y método de detección en tiempo real de estados emocionales mediante visión artificial y escucha del lenguaje natural con el número P202230488 fue solicitada por NEUROLOGYCA SCIENCE & MARKETING SL mediante los servicios del agente Silvia Hernández Presas. El registro [modality] por Sistema y método de detección en tiempo real de estados emocionales mediante visión artificial y escucha del lenguaje natural con el número P202230488 está clasificado como G06V 40/16,G10L 25/63 según la clasificación internacional de patentes.

Otras invenciones solicitadas por NEUROLOGYCA SCIENCE & MARKETING SL

Es posible conocer todas las invenciones solicitadas por NEUROLOGYCA SCIENCE & MARKETING SL entre las que se encuentra el registro de patente nacional por Sistema y método de detección en tiempo real de estados emocionales mediante visión artificial y escucha del lenguaje natural con el número P202230488. Si se desean conocer más invenciones solicitadas por NEUROLOGYCA SCIENCE & MARKETING SL clicar aquí.Otras invenciones solicitadas en la clasificación internacional de patentes G06V 40/16,G10L 25/63.

Es posible conocer invenciones similares al campo de la técnica se refiere. El registro de patente nacional por Sistema y método de detección en tiempo real de estados emocionales mediante visión artificial y escucha del lenguaje natural con el número P202230488 está clasificado con la clasificación G06V 40/16,G10L 25/63 por lo que si se desea conocer más registros con la clasificación G06V 40/16,G10L 25/63 clicar aquí.Otras invenciones solicitadas a través del representante SILVIA HERNÁNDEZ PRESAS

Es posible conocer todas las invenciones solicitadas a través del agente SILVIA HERNÁNDEZ PRESAS entre las que se encuentra el registro patente nacional por Sistema y método de detección en tiempo real de estados emocionales mediante visión artificial y escucha del lenguaje natural con el número P202230488. Si se desean conocer más invenciones solicitadas a través del agente SILVIA HERNÁNDEZ PRESAS clicar aquí.Patentes en España

Es posible conocer todas las invenciones publicadas en España entre las que se encuentra el registro patente nacional por Sistema y método de detección en tiempo real de estados emocionales mediante visión artificial y escucha del lenguaje natural. Nuestro portal www.patentes-y-marcas.com ofrece acceso a las publicaciones de patentes en España. Conocer las patentes registradas en un país es importante para saber las posibilidades de fabricar, vender o explotar una invención en España.Patentes registradas en la clase G

Es posible conocer todas las patentes registradas en la clase G (FISICA) entre las que se encuentra la patente Sistema y método de detección en tiempo real de estados emocionales mediante visión artificial y escucha del lenguaje natural con el número P202230488. Conocer las patentes registradas en una clase es importante para saber las posibilidades de registrar una patente en esa misma clase.Patentes registradas en la clase G06

Es posible conocer todas las patentes registradas en la clase G06 (COMPUTO; CALCULO; CONTEO) entre las que se encuentra la patente Sistema y método de detección en tiempo real de estados emocionales mediante visión artificial y escucha del lenguaje natural con el número P202230488. Conocer las patentes registradas en una clase es importante para saber las posibilidades de registrar una patente en esa misma clase.Patentes registradas en la clase G06V

Es posible conocer todas las patentes registradas en la clase G06V () entre las que se encuentra la patente Sistema y método de detección en tiempo real de estados emocionales mediante visión artificial y escucha del lenguaje natural con el número P202230488. Conocer las patentes registradas en una clase es importante para saber las posibilidades de registrar una patente en esa misma clase.Patentes registradas en la clase G10

Es posible conocer todas las patentes registradas en la clase G10 (INSTRUMENTOS DE MUSICA; ACUSTICA) entre las que se encuentra la patente Sistema y método de detección en tiempo real de estados emocionales mediante visión artificial y escucha del lenguaje natural con el número P202230488. Conocer las patentes registradas en una clase es importante para saber las posibilidades de registrar una patente en esa misma clase.Patentes registradas en la clase G10L

Es posible conocer todas las patentes registradas en la clase G10L (ANALISIS O SINTESIS DE LA VOZ; RECONOCIMIENTO DE LA VOZ; PROCESAMIENTO DE LA VOZ O EL HABLA; CODIFIC) entre las que se encuentra la patente Sistema y método de detección en tiempo real de estados emocionales mediante visión artificial y escucha del lenguaje natural con el número P202230488. Conocer las patentes registradas en una clase es importante para saber las posibilidades de registrar una patente en esa misma clase.

¿Tienes alguna duda?

Escribe tu consulta y te responderemos rápida y gratuitamente.

P202230486

P202230486